引言

2023年11月29日,一份北京互联网法院的判决书引爆了法律圈。

国内终于就“AI画图”作品的著作权归属以及侵权认定下达了首份判决文书。

笔者第一时间仔细研读了该份文书

但对法官的认定部分,持有一定反对意见

法官认为,只要经过“设计人物的呈现方式、选择提示词、安排提示词的顺序、设置相关的参数、选定哪个图片符合预期等等“,生成作品就能构成”智力成果“的要件,使用者就可以拥有输出作品的著作权

如果熟悉AI以及Stable Diffusion软件原理的话

就可以根据该判决书推导出这样一个事实

未来,谁拥有足够的算力

谁就可以垄断国内AI生成美术作品著作权

与其他仅从判决书进行分析的同行不同

笔者将会尝试从技术上进行分析

希望带给各位读者不同的角度与体验

*本文仅为笔者个人观点,不视为任何法律建议或法律意见。

**感谢“知产库”分享的判决书

一、判决书简要归纳

相信很多读者朋友都看过或者听说了判决书的内容,但为了方便后文阅读,笔者在此对判决书的内容进行一个简单的归纳。

案情:

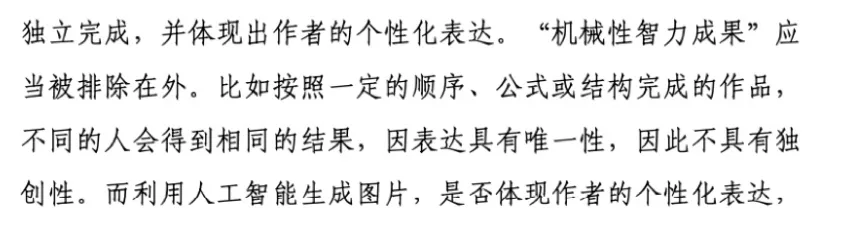

原告李某使用了Stable Diffusion软件(一款AI绘图软件)生成了涉案图片后,发表在了小红书平台;被告刘某为百度百家号博主,在未获得原告的许可且截去了原告在小红书平台署名水印的情况下,在其博文中使用了涉案AI图片,使得相关用户误认为被告为该作品的作者。

原告发现后向北京互联网法院提起诉讼,诉讼请求为:

1.请求判令被告在涉案百家号发布公开声明向原告赔礼道歉,消除其侵权行为给原告造成的影响;

2.请求判令被告赔偿原告经济损失5000元。

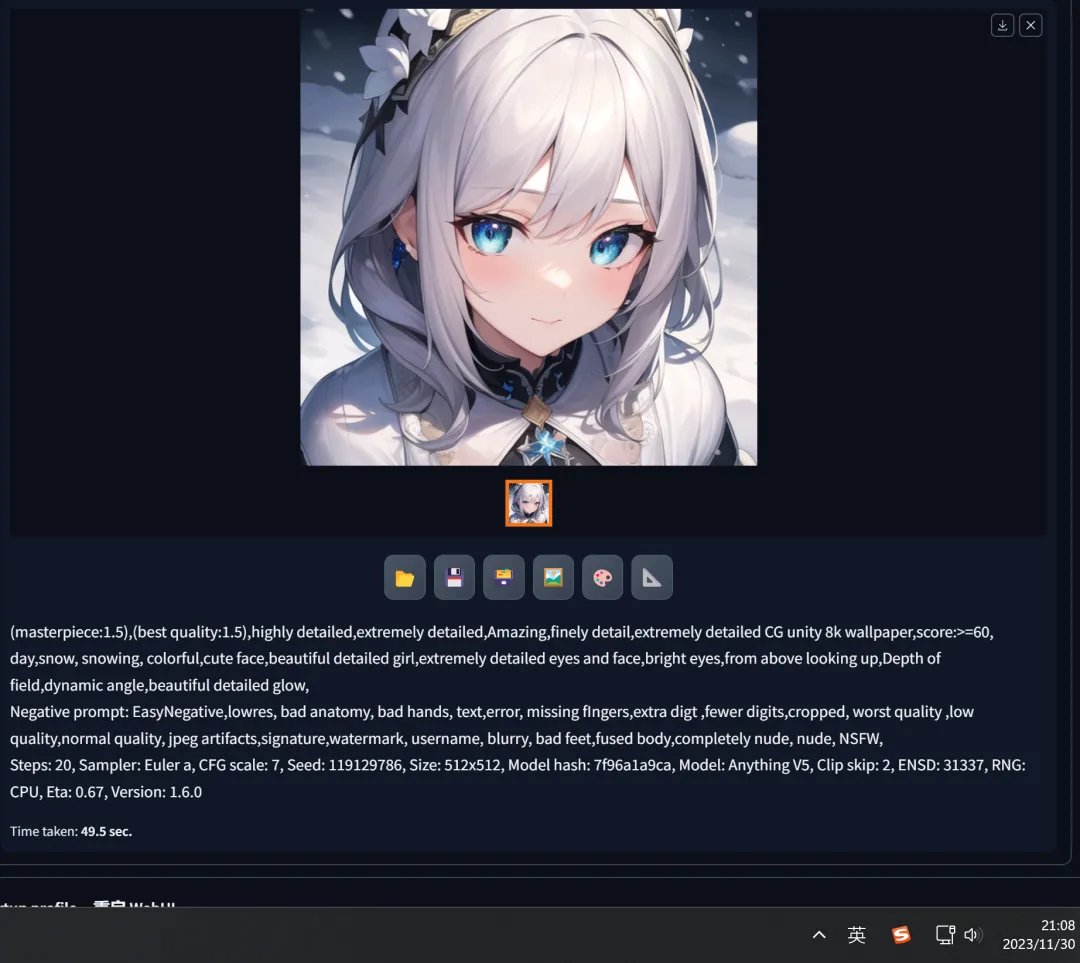

原告还在庭审中展示了如何利用Stable Diffusion软件一步步复现绘制涉案AI图片的过程。

法院认定:

一、 涉案图片是否构成作品,构成何种类型作品

关于“智力成果”:

从原告构思涉案图片起,到最终选定涉案图片止,这整个过程来看,原告进行了一定的智力投入,比如设计人物的呈现方式、选择提示词、安排提示词的顺序、设置相关的参数、选定哪个图片符合预期等等。涉案图片体现了原告的智力投入,故涉案图片具备了“智力成果”要件。

关于“独创性”:

原告对于人物及其呈现方式等画面元素通过提示词进行了设计,对于画面布局构图等通过参数进行了设置,体现了原告的选择和安排。另一方面,原告通过输入提示词、设置相关参数,获得了第一张图片后,其继续增加提示词、修改参数,不断调整修正,最终获得了涉案图片,这一调整修正过程亦体现了原告的审美选择和个性判断。

因此,涉案图片并非“机械性智力成果”。在无相反证据的情况下,可以认定涉案图片由原告独立完成,体现出了原告的个性化表达。综上,涉案图片具备“独创性”要件。

关于是否属于“机械智力成果”:

原告通过变更个别提示词或者变更个别参数,生成了不同的图片,可以看出,利用该模型进行创作,不同的人可以自行输入新的提示词、设置新的参数,生成不同的内容。因此,涉案图片并非“机械性智力成果”。

二、原告是否享有涉案图片的著作权

1.模型:

因为我国著作权法认定“作者”限于自然人、法人、非法人组织,因此生成涉案图片时所使用的模型不能成为“作者”。

2.人工智能软件(Stable Diffusion的作者):

因其没有创作涉案图片的意愿、没有预先设定后续创作内容、未参与后续创作过程,因此只是创作工具的生产者。

3.原告:

原告是直接根据需要对涉案人工智能模型进行相关设置,并最终选定涉案图片的人,涉案图片是基于原告的智力投入直接产生,且体现出了原告的个性化表达,故原告是涉案图片的作者,享有涉案图片的著作权。

三、被诉行为是否构成侵权,被告是否应当承担法律责任

被告传播涉案图片的行为构成侵犯原告作品“信息网络传播权”;

被告传播涉案图片时抹去原告署名的行为构成侵犯原告“署名权”。

判决结果:

1.被告须在其百家号上发布道歉声明,至少维持24小时;

2.被告赔偿原告损失500元。

二、基于SD软件原理分析该案著作权认定为何依据不足

1. Stable Diffusion软件及其所用模型的运行原理

笔者曾经就Stable Diffusion软件背后的算法原理进行过讨论,感兴趣的读者可以详见:

算法模型应成为人工智能(AI)侵权审查的核心——以扩散(Diffusion)模型和算法为例

Diffusion算法简要来说是通过关联训练集中的素材和相应的标注信息,使算法模型能够学习这种关联性,从而理解具有相同标注信息的训练集图像的共性规律。在训练过程中,通过模拟分布像素点(即“路径”)的各种可能性,生成图像以满足这种共性规律。而在生成阶段,我们通过输入的需求(即“提示词”)匹配训练时的标注信息,寻找最符合这类标注信息所代表的图像的生成路径,最终生成符合提示词内容的图像。

而Stable Diffusion软件中的参数“种子”则代表了某一条具体的“路径”。

2. 采用相同的“路径”,生成结果必定唯一

在判决书中,我们可以了解到原告在庭上展示了通过再次输入相关正反面提示词、迭代次数、LoRA模型权重等等参数,在固定了“种子”的情况下,重新生成出了涉案图像。

这实际已意味着涉案图像本质是基于固定的参数“机械生成”的结果。

而“可复现”也是Stable Diffusion软件区别于其他AI生成软件(例如Midjourney、DALL·E等)的最大特色。

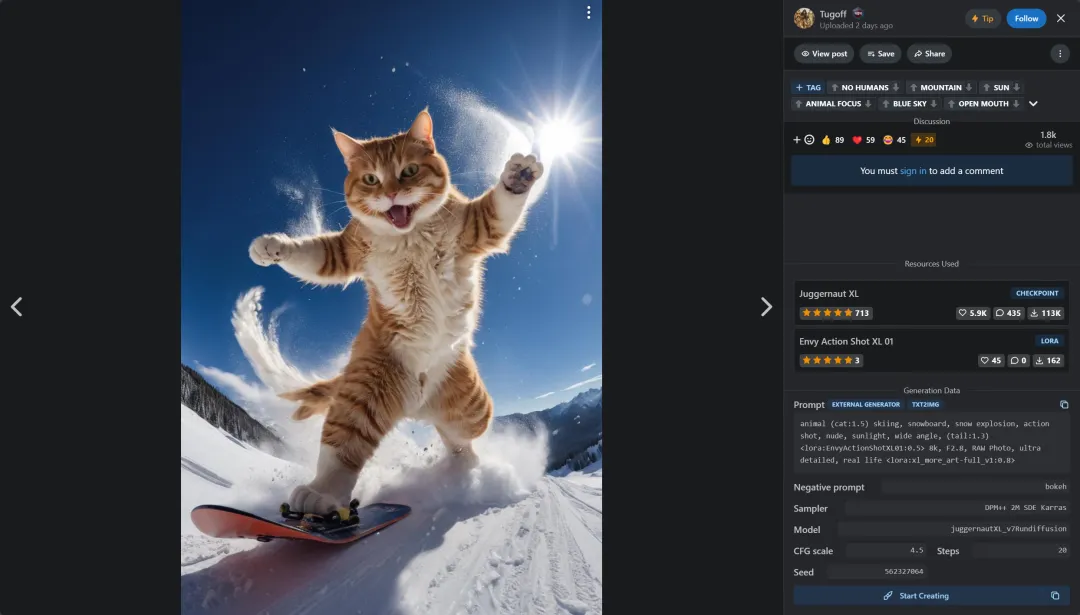

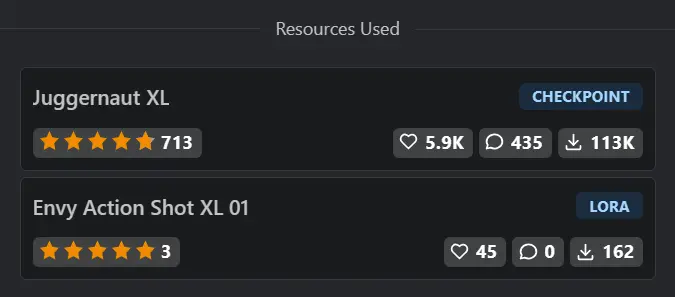

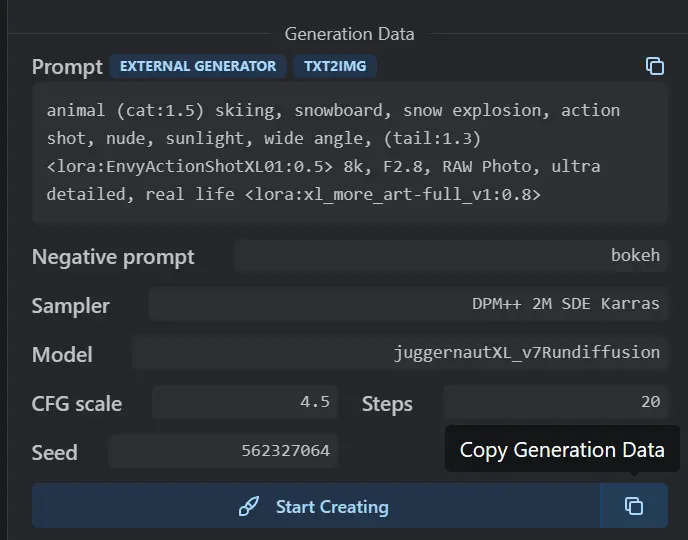

在知名AI模型分享网站Civitai中,有大量用户分享的AI图像。这些图像都会包含了具体使用的模型(Resources)以及生成时所使用的参数(Generation Data),网站还提供了“一键复制”参数的功能。

通过按下复制按钮,可以得到的生成参数信息如下:

animal (cat:1.5) skiing, snowboard, snow explosion, action shot, nude, sunlight, wide angle, (tail:1.3) <lora:EnvyActionShotXL01:0.5> 8k, F2.8, RAW Photo, ultra detailed, real life <lora:xl_more_art-full_v1:0.8>

Negative prompt: bokeh

Steps: 20, VAE: sdxl_vae.safetensors, Size: 832×1216, Seed: 562327064, Model: juggernautXL_v7Rundiffusion, Version: v1.6.0-2-g4afaaf8a, Sampler: DPM++ 2M SDE Karras, VAE hash: b3165c12ca, CFG scale: 4.5, Model hash: 0724518c6b, “EnvyActionShotXL01: 46f3acce826a, xl_more_art-full_v1: fe3b4816be83”

其他用户只要下载并使用相同的模型,在软件界面中一键导入上面复制的生成参数,就可以在自己的设备上复现这幅图像。

虽然因电脑硬件设备、软件所使用的插件版本、模型版本等影响,最终结果可能不能完全100%复刻,但生成的结果也足以构成“实质性相似”,以下为一些网友测试的图像:

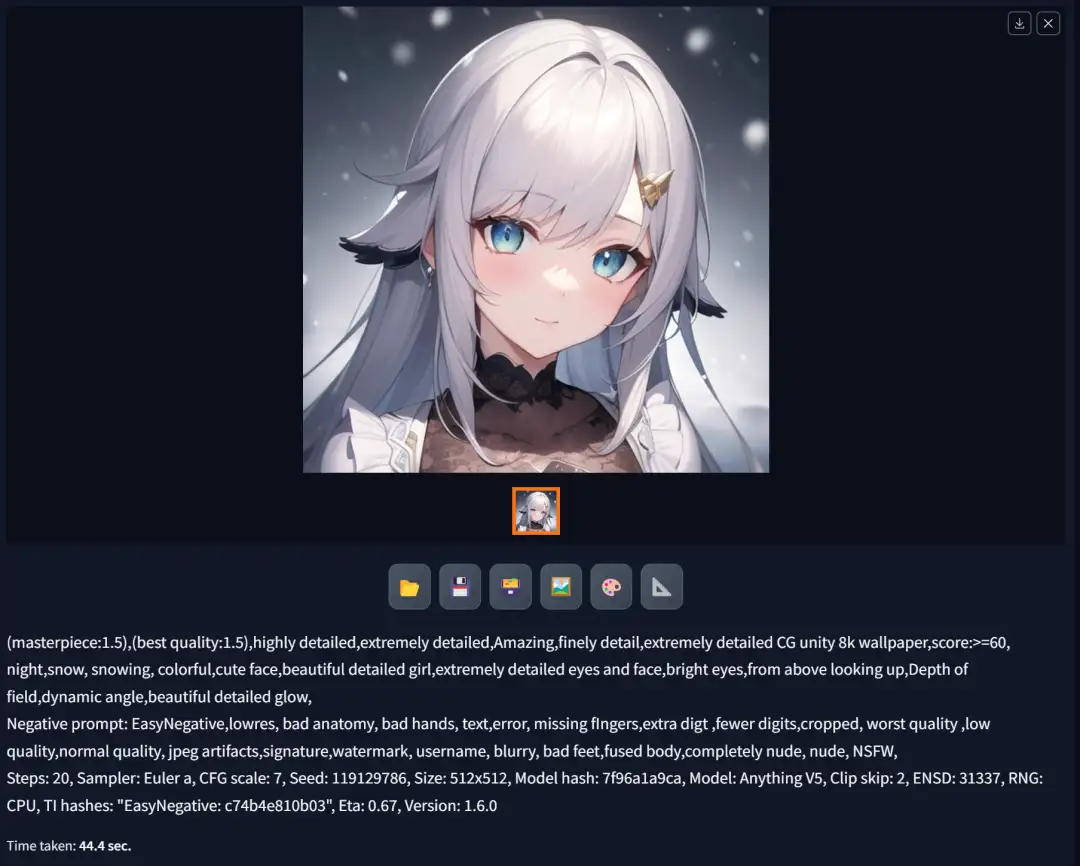

笔者根据判决书记载的参数,在不知其软件版本、插件、硬件设备、未知判决书中未提及参数下,在笔者的电脑中也可以复现到以下结果,除了身体外,脸部、背景、下半身衣服都有明显的相似性,整体构图也非常相似:

而当影响结果的因素足够少时,则会像原告复现流程一样,达到生成结果完全100%相似。

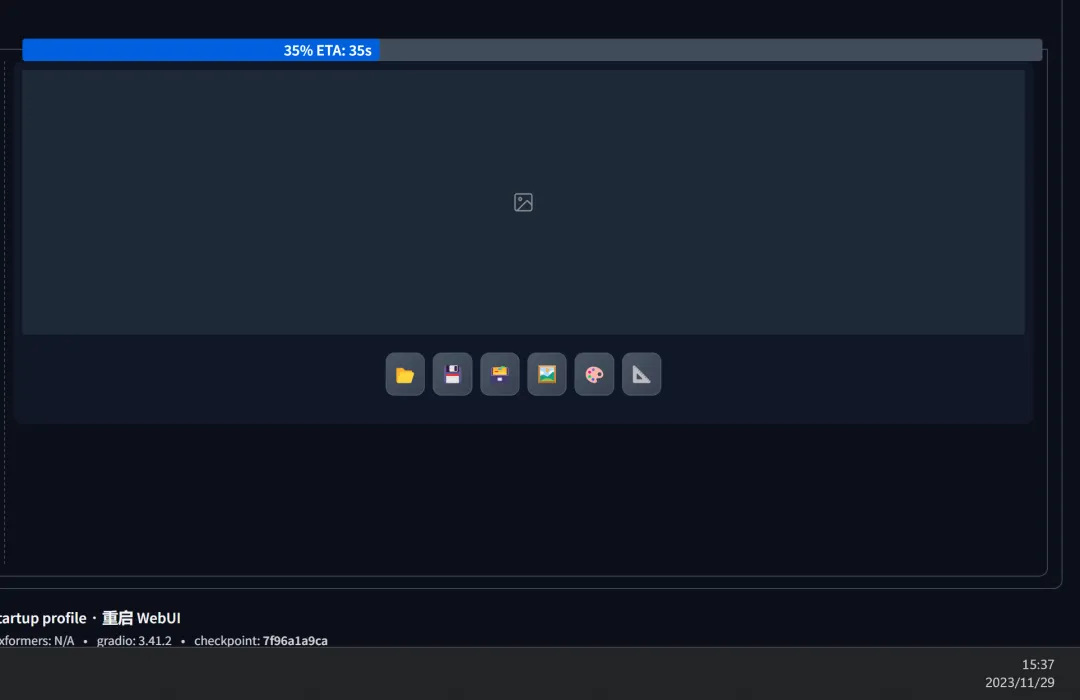

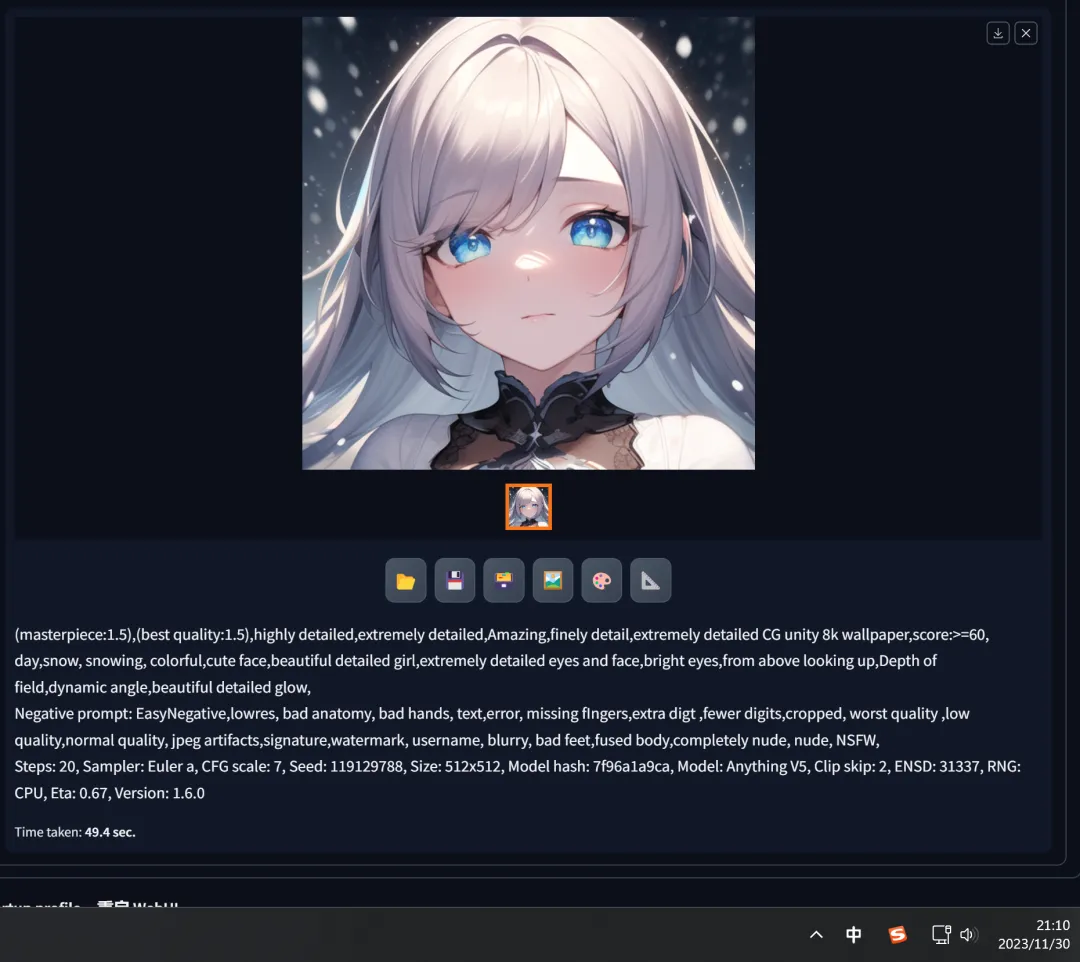

为进一步展示,笔者在此记录一次测试结果:

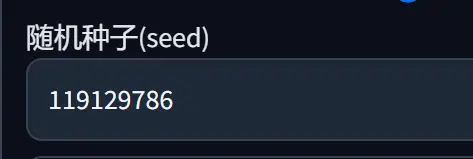

1.在Stable Diffusion软件输入各项基本生成参数后,让随机种子保持为-1(即随机生成种子,这也是正常生成AI图像的流程,实际使用软件生成图像的过程中,基本不会先固定种子再调整参数),点击图像生成。

2.得到首次生成结果,以及其种子参数:

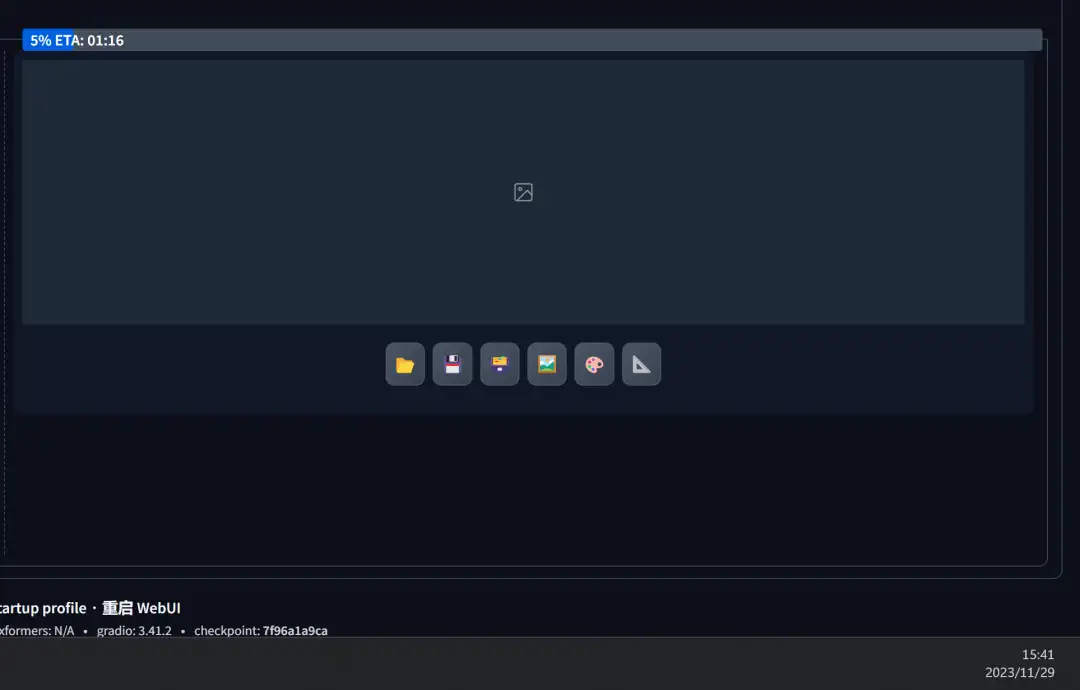

3.重新启动软件,再次输入同样的参数,并把种子参数修改为第二步图像一致的结果,再次点击生成:

4.得到了完全相同的图像:

可见,在采用了相同的模型和生成参数的情况下,使用一样的“种子参数”,生成的图像可足以达到“实质性相似”乃至“相同”的结果。

3. AI生成图像只是根据一定方式计算得出的“机械性智力成果”

无论是原告在案件中展示的复现流程,还是上文测试的结果,均指向了一个事实:

所谓的“AI绘画”只是在训练模型时产生的极大数量级的可能性中,根据算法内的公式,结合输入的参数进行计算,从而指向某一个具体结果并生成对应图像的过程。

原告在复现过程中进行的各种调整,本质上均与最终结果没有任何关系。调整参数的过程只是指向了模型的不同生成结果,只要最终输入参数与生成图像的参数一致,无论此前进行了多少数量级的调整,最终结果均不会改变,正如在普遍环境下1+1=2般固定且准确。

正如判决书中对“机械性智力成果”进行的阐述:

无论生成者是何人,只要在相同的设备、选择一样的模型、按照一定的顺序输入参数,按下鼠标后生成的AI图像结果必定相同,与按下鼠标的人、时间、地点均无任何关系。

“AI生成图像”,起码在目前阶段,只是“机械性智力成果”。

4. 我们只是在“挑选猴子的自拍照”

该案中法官认为,原告调整、修改参数的流程,体现了原告审美选择和个性判断:

然而通过上面的讨论,现在我们已经可以判断出原告(乃至使用AI绘图的我们)只是在一堆”机械性智力成果“中选择出符合人类审美的一幅图片。

法官在判决书中使用了“相机”的例子,在此笔者也想引用另一个“相机”的例子:

2011年,英国摄影师David Slater在印尼野外进行拍摄活动,在拍摄期间他使用三脚架固定相机,并故意离开遥控快门,让黑猴能接近相机。一只母黑猴按下了遥控快门,拍摄了大量照片,其中大多数照片模糊不清,不能使用,但Slater在其中挑选出了最有趣的两张照片,随后网站上发布了它们:

维基百科把这两张照片放置在其网站上,并声明是“猴子拍的”,这让Slater认为维基百科侵犯了其著作权。Slater将维基百科的母公司告上了法院,之后2014年12月,美国著作权局认定的确是“猴子拍的”,并声明非人类所创作的作品不是美国著作权的主体;2016年,美国联邦法官决定猴子无法自行持有这些图像的著作权;2018年,第九巡回上诉法庭维持原判。

如果与本案进行类比,则原告的行为与Slater并无二致,其本质都只是在一堆不属于人类创作的作品中进行挑选,原告调整参数的过程只是“在一个充满了各种图像的黑箱子中变换不同手势抽出其中某一张”,而这张图本质并没有加入任何自己“创作”的部分。

正如“AI绘图”在民间的俗称:“抽卡”,我们既不会把抽奖的过程(哪怕是由我们自己设置奖品可能的类型、颜色、大小、形状、概率等等的“参数”)认为是“创作过程”,也不会认为抽出来的奖品就是自己拥有著作权的“作品”,同样地,我们也不应该认定“抽奖者”拥有在“AI绘图”时“抽取”出来的“作品”的著作权。

5. 甚至连提示词都不具备“创作”的要素

熟悉Stable Diffusion软件的读者可能会知道,网上存在很多提示词插件,同时也有大量的网友在提示词分享网站、论坛、博客等分享各种实用的提示词模版。

而使用LoRA模型时,往往也要求输入触发提示词,否则最终生成结果无法添加上LoRA模型的效果:

之所以存在如此多的限制,原因在于,能输入并影响生成结果的提示词范围,与模型训练集的“标记”成正相关。

任何人都不能超出“标记”范围输入提示词,不能“创作”超出模型内已有标记的内容,否则绘图程序将会无法理解这个提示词的含义,不能在输出结果中生成与这个提示词相关的元素内容。

原告在庭审中也提到,其“创作”过程中使用的提示词,绝大部分都是直接复制他人的模版:

而其自行编辑的反向提示词,也并未超出常见范围,仅仅只是在已有的范围内进行挑选,并非其“独立创作”的结果。

6. 纵观“创作”的全流程,原告不具备“创作”行为,不应获得著作权

通过上面的分析,我们现在可以得出一个结论了:

原告无论是输入参数、调整参数、选择生成结果,都只是在模型所能提供的“可能性“里进行。AI生成的图像本质只与设备、模型、软件相关,与使用者并没有任何关联性,任何人基于同样的设备、模型、软件,均可超越时空获得一模一样的结果,因此涉案AI生成图像完全符合“机械性智力成果”的定义。

使用者在直接使用AI生成结果时,仅仅是进行了基于人类审美进行选择的过程,与图像的创作并没有任何关联性,不具备“创作”的要素;其输入参数的行为只是限定了“可能性”的范围,与结果的产生没有任何关联性,不具备“通过投入智力元素”影响生成结果的要件。

由此可见,无论从涉案图像的本质分析,还是基于原告的生成过程,原告均不应享有涉案作品(更应称为“涉案图像”)的著作权。

三、判决书中的其他细节问题

此外,判决书中还存在其他细节问题:

1. 原告的复现流程并没有可证明其创作行为的证明力

判决书中提及,正因为原告复现视频中,原告展示出来的“调整参数”行为,表现出了原告的“审美选择和个性判断”过程,因此得出涉案图片具有“独创性“的结论。

与传统电子美术数据源文件存在图层、操作日志等信息不同,AI绘图(以Stable Diffusion而言)仅有生成的图像,以及图像中携带的生成参数信息,并不包含任何“过程”的记录。

正如上文提及,在最终参数一致的情况下,无论“复现视频”中展示了何种复杂的调试过程,只要最终参数一致,即可生成一致的图片。

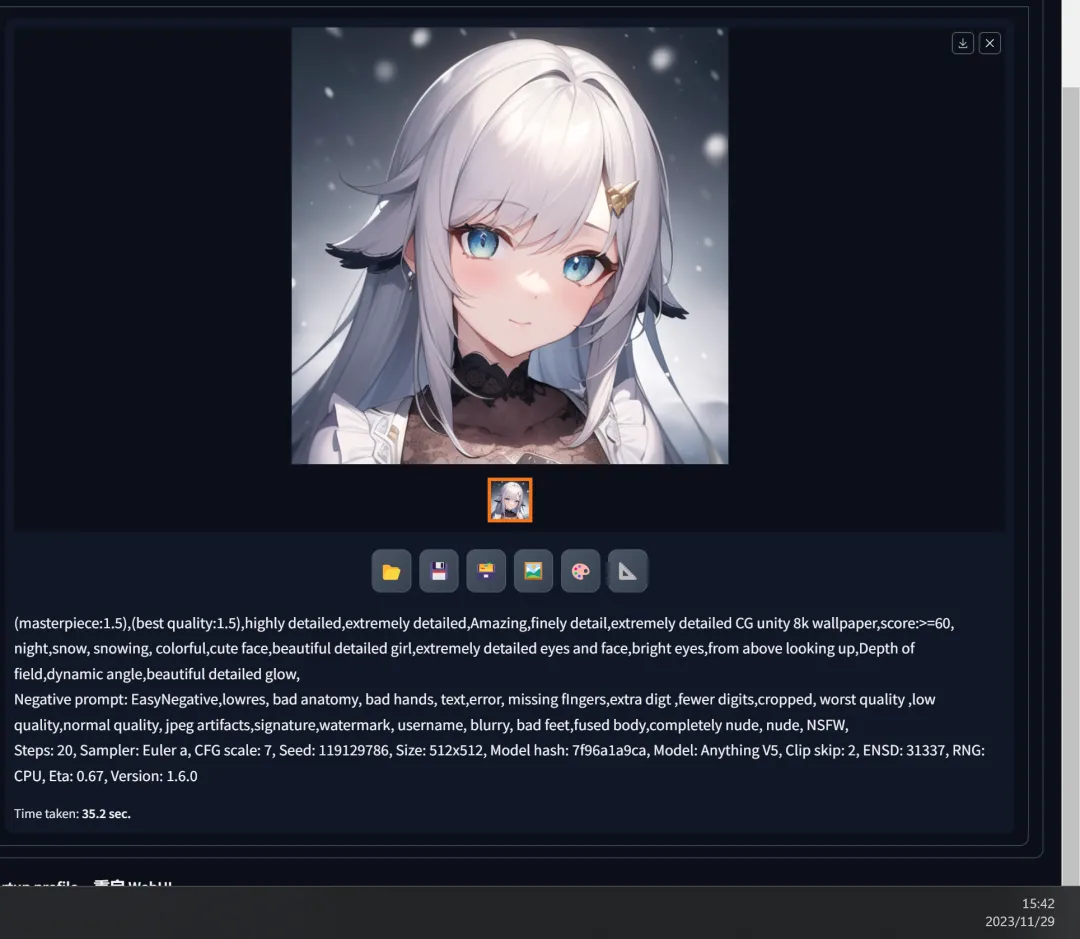

笔者再次通过前文中的例子进行说明:

- 在Stable Diffusion中,在不改变种子的情况下调整其中一个关键词,将“night(夜晚)”修改成“day(白天)”,按下生成按钮,得出一幅完全不同的图像:

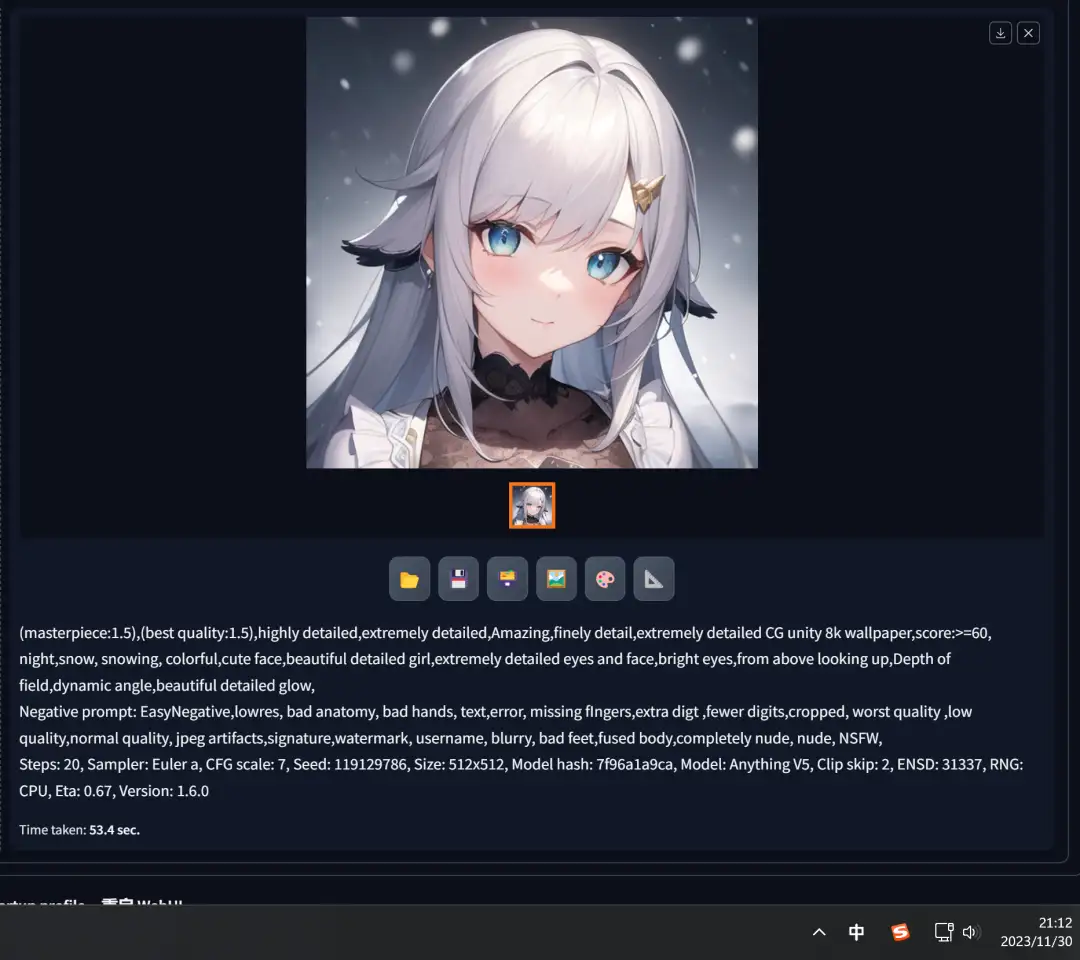

2. 然后保持当前提示词不变,将“种子”修改为“119129788”并按下生成按钮,得到了另一张不同的图像:

3. 最后把提示词和“种子”重新修改为原本的版本,再次按下生成按钮,可见已经完全“复现”了原本的图像:

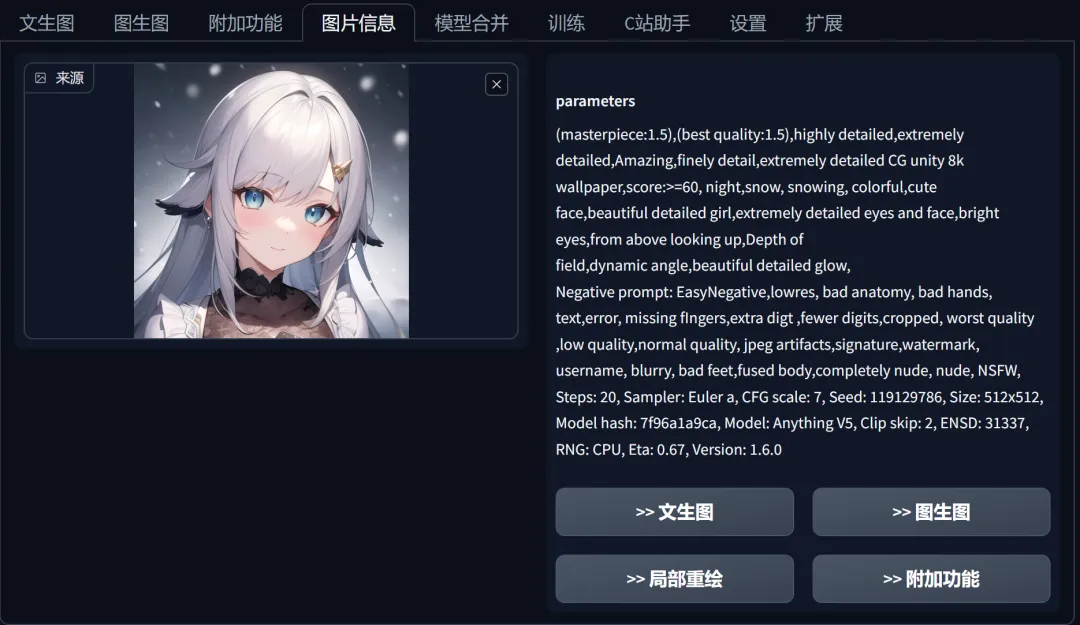

事实上,任何人都可以通过Stable Diffusion的“图片信息”功能读取此前批量生成的任意一张图片的生成信息,通过发送到“文生图”功能,重新调整参数,获得不一样的生成结果。当然,也可以用于复现一样的图像。

虽然没有证据证明原告存在“倒推创作过程”的事实,但仅就“证明力”而言,原告的复现视频并不具备足以证明其“创作过程”的证明力。

2. 原告的“创作过程”与常理存在明显差别

“AI绘图”是一个“抽卡”的过程,任何人都不知道“抽卡”的结果如何,因此主流(乃至绝大部分)Stable Diffusion教程以及普通软件使用者的生成操作,都是通过使用随机种子批量生成大量不同的图像,然后从中选择一张“符合人类审美”的图像(基于某个“种子”)。因为我们不能事先知道某一个“种子”会符合我们审美,批量、随机生成各种不同的“种子”,再从中挑选才是最优解。

但原告的“复现过程”,却是反其道而行之,先固定了“种子”,再调整LoRA模型模型,然后再次通过调整“种子”和提示词生成了涉案图片。

在生成时先固定“种子”,意味着每次只能生成一张图片,这无论是从实用性还是效率来说,都不具备明显的优势。

尤其当新型家用电脑显卡可以数秒生成一张图片的情况下,从大批量生成图中选择,比“随机输入一个种子”要有效得多。

但笔者也不排除真的有人采取类似的方式生成图像,或原告只是为了方便展示需要而采用了此种办法。

笔者只是从“一般理性”而言进行陈述,并不代表笔者认为原告存在“倒推创作流程”的情况。

四、本案可能带来的影响

假设本案成为了日后相关判决的“案例”,则可能对国内著作权环境带来以下影响:

1.可能改变著作权“天然拥有”的特质

根据《著作权法》第二条,无论作品是否发表,均享有著作权,即“天然拥有”。

第二条 中国公民、法人或者非法人组织的作品,不论是否发表,依照本法享有著作权。

《中华人民共和国著作权法》

但从AI绘图的原理可知,基于“种子”结果唯一性,任何人都可能拥有同一张或近似图片的“著作权”,而影响获得这张图著作权的唯一因素,仅仅只是按下鼠标并“幸运地”随机出这个“种子”的早晚。

这导致了一个奇妙的现象:

一个作品的著作权人可能是任何人,直到某次鼠标点击之后才坍缩到具体的结果。

一个作品的著作权人也可能超过一个人,只要大家都足够“幸运”随机出了同一个结果。

尤其当模型越小,能生成可能性越少,生成相似图像的可能性就越高。在彼此都生成相似图像的情况下,容易形成“谁才是这张图的著作权人”以及“谁侵犯了谁的权利”的争议。

基于在先优先权判断吗?

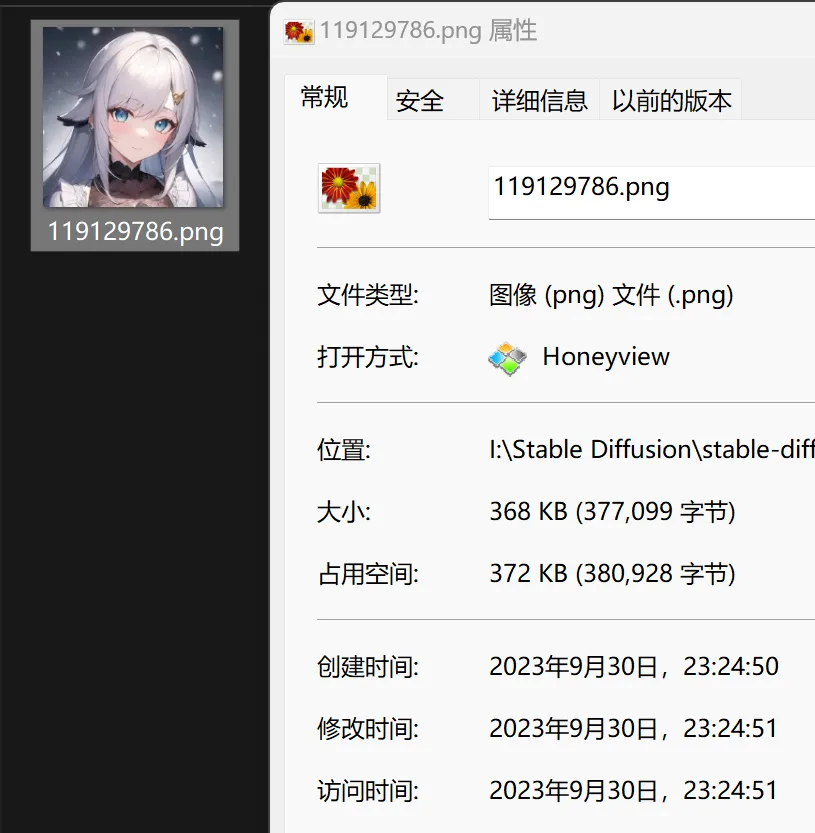

但电子数据的特征就是“可随意修改”,谁都能通过调整设备时间来变更图像的生成时间,例如向前回溯两个月:

凭目前的技术,绝大部分人难以确认一幅AI绘图作品的真实生成时间,难以判定该图像的在先权利归属。

基于先发表或先存证判断归属吗?

那则严重破坏了作品著作权的“天然拥有”权利,变成了“谁先声明谁拥有”,任何人都可能仅仅因为“晚了发表”,或仅仅保存在电脑硬盘、草稿中,或仅仅只是想着“下一期再用”而丢失了作品的著作权。

这使得“著作权”不再符合“创作即拥有”,反而需要潜在的权利人通过大量可靠性证明,来争抢著作权权利,否则将遭受无故失去著作权的风险。

2. 可能导致著作权从保护“创作”变成保护“结果”

传统作品的“结果”是创作流程的体现,保护作品本质是保护完整的“创作行为”,这也是著作权的核心思想:保护表达。

而AI作品生成时基于一样的创作流程,在保持其他参数一致的情况下,只需要简单调整”种子“参数,往往可以得到完全不同的结果。

本案中,法官认为原告的“创作过程”具有“独创性的智力投入”,从而应当受到保护。

但问题在于,我们应当保护的是何种“创作过程”?

是生成AI图像所经历的调整过程?

是最终生成AI图像所用的参数(正常而言创作过程不包含思考“种子”)?

还是创作者点击鼠标最终生成的AI图像文件(包含“种子”的最终参数)?

如果从应该保护“思考过程”认为应该保护最终生成使用的参数,则意味着一个人可以独占该参数下的全部可能图像(全部“种子”)的著作权,这基于公平性而言,明显不具有可行性;

如果是认为只应保护最终生成的结果,则意味着任何一个人都可以使用他人的思考成果 —— 本案认定的“独创性的智力投入”—— 通过仅仅随便输入一个新“种子”,就可以轻松获得具有一定差异性、在传统法律认定中难以构成侵权认定的新图像结果。

这在传统美术作品中可能只是“加一笔”的劳动程度,甚至不用增加任何意义上的“智力投入”,居然就可以获得新作品的完整著作权。

但基于司法而言,“保护结果”反而是最容易进行判断侵权行为的办法。当一个作品抹去了生成信息时,能判断是否侵权的可能性就剩下“外观相似度”,但在AI绘图中,改变最终产品的相似度反而是最不需要“智力投入”的部分。

保护“参数”,则容易形成过渡保护;

保护“成品”,则本质上不是保护“思考的过程”,只是保护人力无法干预的“机械生成结果”。

3. 著作权认定办法难以适用于不同的AI绘图软件,容易造成歧视

对于Stable Diffusion需要一定的技术基础才能搭建的情况,更多人可能会选择Midjourney、DALL·E、文心一言等国内外的AI绘图平台。

这些平台特点是不需要用户关注具体的生成参数和模型,只需要输入提示词即可输出图像结果。

其输出结果是完全随机的,就算相同的提示词也无法复现同一张图片;也不存在基于某张图像调整细节的可能性,每次都是基于提示词重新生成。

在使用这些平台时,用户的“独创性的智力投入”,会因为无法调整各类参数,明显低于使用Stable Diffusion软件的用户。

如果使用与本案相同的判定标准,则那这些用户也能获得生成结果的著作权吗?

哪怕使用者们只是输入了一段提示词?

如果认为应该保护著作权,那应该是保护提示词,还是那个完全随机、无法复现的生成结果?

如果认为单独的一段提示词无法构成“智力投入”,那同样都是使用AI绘图,具有更高技术能力或者使用更复杂软件的人,是否就拥有比别人更多的权利?

传统创作软件中,无论是使用系统自带的绘图软件,还是下载的高级版绘图软件,所画出来的原创图像,创作者都能具有同样的著作权。

但到了AI绘画软件这里,如果认为输入提示词与调整参数的行为才能构成创作,则是人为地制造了壁垒与歧视,显失公平性。

4. 可能导致算力垄断著作权

如果不改变目前著作权的原则,单就本案认定情况而言,我们可以推导出一个恐怖的结论:

在未来,谁拥有更多的硬件算力,谁就可以更快生成更多图片,获得更多的著作权。

如果认定创作者拥有生成AI图像的著作权,基于无法对“创作过程”和“创作时间”证伪,拥有更多算力的创作者就可以通过不断随机生成某个模型基于各类参数的图像,尽可能穷尽生成结果的可能性,达到对该模型所能生成图像著作权的垄断。

又因为“种子”结果唯一性,在抛弃了大部分不符合人类审美的结果后,实际可用的“种子”可能有限。普通人可能会因为仅仅硬件算力较差,较晚生成该模型的可用图像,而丧失该图像的著作权,甚至可能导致因使用了实质性相似的图像而构成侵权的后果 —— 如果熟悉目前Stable Diffusion软件的读者,应该清楚了解小模型,尤其小型LoRA模型,最终成品的相似程度和相似频率有多高。

笔者认为,这是提供了一种资产垄断知识产权的未来可能性。

法官在判决书中认为,AI绘图软件是一种新技术工具,通过正确适用著作权制度,可以鼓励并让更多的普通人投入到创作的过程中。

虽然出发点很好,但这显然只考虑了“人”的参与部分,没有考虑到“机器”参与的部分。

传统作品的产出效率只跟人的创作能力与效率相关,任何人产出作品、获得著作权的机会都是平等的;

但AI绘图作品的产出效率与机器性能有着极为重大的关联性,甚至达到了几十倍到上百倍的差距。

举个笔者亲身体会,目前家用旗舰显卡Nvidia RTX 4090使用Stable Diffusion时可以达到1秒生成一张图片,而笔者自己的显卡则往往需要接近50秒。

如果认为AI绘图软件使用者对生成的图片都具有著作权,那这50倍的差距就是50倍的著作权获取效率差距。当都在使用同一个模型生成图片时,拥有4090显卡的人则可能更早“抽出”可用的图片,而笔者则拥有更高的侵权概率。

这种不公平的现实,不应成为我国著作权的未来。

五、个人观点:AI绘图中训练集、模型与生成作品的著作权归属

针对AI所带来新的知识产权争议,笔者在此也想分享一下个人对AI绘图中的三要素的著作权归属观点,希望能抛砖引玉,欢迎各位一起讨论:

1. 训练集

训练集可以简单理解成训练模型时所收集的各类作品图,笔者认为其中包含了两类:完全原创训练集以及包含第三方作品训练集。

完全原创训练集是指,训练集中的所有作品都是模型制作者本身所拥有合法知识产权的,这份训练集的著作权,笔者认为完全归模型制作者所有,也不会侵犯任何第三方的权利,这应该也不需要展开讨论了。

包含第三方作品训练集,顾名思义,则是训练集中包含了部分或者全部都是第三方作品的训练集。笔者认为这类训练集,第三方作品的著作权归第三方所有,训练集本身(这时是汇编作品)的著作权归收集者所有,且收集和使用其训练大模型的行为并不会侵犯第三方的权利,除非使用了第三方明确声明不允许用于训练AI模型的作品。

笔者在之前的文章也表达过类似的观点(可详看本文前半部分贴过的链接文章),AI模式的训练过程,起码Diffusion算法,只是学习各种共性,而人类作品的共性都离不开人类共同的文化、思想、审美,就算一个作品有创新的部分,在绝对的大模型中,这种创新都会显得微不足道(此前的文章中已经分析过LoRA模型的侵权问题,在此不再复述)。最终生成的大模型,必然不会侵犯训练集中第三方作品作者的著作权。

但笔者也尊重每位著作权人对其作品的保护权利,声明“不允许用于AI训练”是著作权人的权利,训练集收集者也有义务尊重这种权利。

2. 模型

AI模型特指已经经过使用训练集配合特定算法训练,可直接用于推理生成AI绘图成品的模型。

笔者认为,这类模型的著作权人是模型的制作人,但除非使用了完全原创训练集,否则模型著作权人不享受该模型生成作品的著作权。

使用了完全原创训练集时,意味着模型的生成结果都是模型著作权人拥有著作权作品的特性,这种特性虽然同样基于了社会的共性,但包含了更多著作权人的“思考结果”,是以往“智力成果”的归纳与总结,理应由著作权人自行享有相关作品的著作权。

当使用了包括第三方训练集时,这时模型的生成结果更多是社会的共性,这种共性并非模型著作权人的“思考结果”,而是属于训练集中乃至全人类共同努力的结晶,任何一个人都不应该且没有权利独自享有某种社会共性所代表的著作权。

3. 生成作品的著作权

除非是使用了基于自己作品训练出的模型所生成的作品,否则任何人都不享有直接AI生成作品的著作权。

直接AI生成作品是指,没有经过使用者二次创作,单纯由AI模型所生成的各类图片。

笔者支持AI只是工具的观点,但使用AI的人,仅仅只是使用者,并非生成结果的创作者。AI所生成的一切“作品”,起码在目前,都是基于数学与统计学的计算结果。无论使用者在生成结果前花费了多少“智力”与“努力”,都仅仅只是“不断尝试在公式上套入不同的参数以求获得更好的结果”,无论生成的过程还是最终的结果,实际并没有多少人为干预因素。

AI直接生成的“作品”不具备著作权的要素,因而也不应受著作权法保护。

但一旦基于AI作品进行了二次创作,包括重新绘制图像中的部分内容、修复结构错误、添加更多的元素内容等,当人为添加的部分超越了AI作品本身所占的比例时,则使用者享有新作品的著作权。

此时AI作品只是成为了新作品素材的一部分(如同正常绘画时使用的参考图),人的“智力投入”已经超过了“机械生成”的部分,因此达到了获得“著作权”的要件。

六、总结

本案中,被告属于直接使用了原告的图,这点笔者就目前证据而言暂时没有任何异议。

但笔者认为,基于本文提及的技术原理,原告同样不具备涉案图片的著作权,被告并不构成侵权。

不管本案是否属于部分网友认为的“人为第一案”,针对AI带来的新型知识产权问题,我们应该都能认识到一点:知识产权相关的法律保护方式和认知,需要更快与技术原理接轨了。

针对新技术的知识产权问题,我们不能仍遵循过去的经验,更应从技术原理出发,通过深入分析技术的本质,结合知识产权的核心保护原则,去判定该技术是否构成知识产权以及相关行为是否侵权。

否则只会容易着了“经验主义”与“主观主义“的道。

北京市隆安(广州)律师事务所律师、隆安湾区人工智能法律研究中心高级顾问。具有近十年互联网法律实务经验,曾先后为创业板上市互联网企业、全国互联网综合实力 50 强企业、互联网快时尚零售独角兽等互联网企业提供法律服务,擅长办理互联网类企业诉讼与合规业务,擅于通过计算机技术手段深度挖掘证据。

您可以通过以下方式联系我: 电子邮箱:liboyang@lslby.com 微信号:legal-lby